别让测试数据淹没你:从“数据多”到“结论明”的思维转变

面对堆积如山的性能测试报告、密密麻麻的监控图表和海量日志,许多团队的共同感受是无从下手。数据越多,反而离结论越远。在我们服务企业的过程中发现,高效的产品测试数据统计分析,其瓶颈往往不在于监控工具的能力,而在于分析者是否建立了一套正确的结构化分析框架。

找到性能短板的关键,并非盲目地收集更多数据,而是掌握一套如同侦探办案般的严谨分析流程。这套流程的核心在于,将孤立的数据点串联成有意义的证据链,最终锁定问题的根源。本文将为你提供一套与具体工具解耦的“侦探式”分析流程,帮助你从纷繁的数据中快速定位性能瓶颈。

停止孤立看指标:高效性能分析的3大核心原则

在深入具体的分析步骤之前,我们必须先建立三个基本共识。它们是区分专业与业余性能分析师的分水岭。

原则一:关联分析优于孤立读数

一种常见的错误做法是,分析师在报告中看到 CPU 使用率达到 95%,就立刻断言“CPU 成为瓶颈”。但事实可能并非如此,也许这正是系统高效利用资源的表现。

正确的思维方式,是将直接影响用户体验的指标(如响应时间、错误率)与系统内部的资源指标(如CPU使用率、内存占用、I/O等待)放置在同一时间轴上进行关联分析。你需要回答的问题是:“当响应时间开始飙升的那一刻,系统内部的哪个资源指标也同步出现了极端变化?”

性能问题往往是多个指标异常共振的结果。

原则二:告别“平均值”陷阱,拥抱分位值与拐点

“平均响应时间 200ms”这个指标在很多场景下具有欺骗性。它很可能掩盖了这样一个事实:95% 的用户请求在 100ms 内完成,而另外 5% 的用户却忍受着超过 2 秒的极端延迟。这些被“平均”掉的糟糕体验,恰恰是用户流失的直接原因。

因此,专业的分析必须关注 P95/P99 响应时间,因为它们更能反映用户真实体验的“天花板”。此外,我们还需要通过拐点分析来识别系统的容量上限。在压力测试中,持续增加并发用户数,观察吞吐量(TPS/QPS)的变化曲线。当吞吐量不再随压力上升而增加,甚至开始下降的那个点,就是系统的性能“拐点”,也是各类问题开始集中爆发的临界区域。

原则三:坚持自顶向下,从“症状”到“病根”的排查路径

面对复杂的系统,一个常见的误区是直接扎进底层的代码或配置细节中,如同大海捞针。更高效的排查路径应当是自顶向下的。

分析的起点,永远应该是最贴近用户的“症状”——通常是响应时间的显著延长或错误率的突然攀升。基于这个外部症状,再层层深入,依次排查:应用层(代码逻辑、线程池)、中间件层(消息队列、缓存)、数据层(数据库查询性能、锁竞争),最后才是操作系统和硬件层(CPU、内存、网络延迟)。

这种层层递进的排查方式,能避免你一开始就陷入底层细节的泥潭,确保分析始终聚焦在对业务影响最大的路径上。

四步定位法:手把手教你从性能报告中揪出短板

掌握了以上三大原则,我们就可以将其融入一个标准化的操作流程中。这个四步定位法,能将复杂的分析过程拆解为一系列清晰、可执行的动作。

第一步:定义基线 - 明确性能的“及格线”

没有标准,就无从判断好坏。在进行任何正式的压力测试和分析之前,必须先为系统性能建立一个可量化的评判标准,即“基线”。

操作上,你需要在较低压力、系统绝对稳定的状态下运行一次测试,详细记录此时的关键性能指标(P95响应时间、吞吐量、错误率、CPU/内存占用等)。同时,结合业务层面的服务等级目标(SLO/SLA),共同确定一套明确的性能阈值。例如,“核心交易接口在 500 并发下,P95 响应时间不得超过 300ms,错误率必须为 0”。

第二步:识别异常 - 锁定问题发生的“时间窗口”

有了基线,下一步就是在正式的负载测试过程中,通过对比实时数据与基线,精准地找到性能首次出现恶化的那个时间点或时间窗口。

你需要像监控心电图一样,紧盯以下几个核心曲线:

- 响应时间曲线:是否存在一个明显的、持续的拉升,形成了新的“台阶”?

- 吞吐量曲线:是否在达到某个平台期后,增长停滞,甚至随压力增加而开始下降?

- 错误率曲线:是否从 0 或一个极低的值开始持续攀升?

一旦观察到这些现象,立即记下其发生的时间点。这个“时间窗口”就是我们后续分析的焦点。

第三步:多维关联 - 绘制“犯罪现场”的指标快照

在锁定了问题发生的“时间窗口”后,核心工作就是绘制出该时刻系统所有相关指标的“快照”,通过多维度关联,找到高度相关的“嫌疑人”。

以下是一份基础的关联分析清单:

- 压力指标 vs 性能指标:观察并发用户数的增长曲线,是否与响应时间的增长曲线在形态上高度一致?

- 性能指标 vs 系统资源:在响应时间飙升的同一时刻,是CPU使用率率先触顶,还是内存占用发生剧烈波动,或是磁盘I/O等待时间急剧增加?

- 应用指标 vs 依赖服务:当应用的错误率上升时,查看其依赖的数据库查询监控,是否存在大量的慢查询或连接超时?或者,第三方API的网络延迟是否也同步出现了峰值?

这一步是整个分析过程的核心,目标是基于数据间的强相关性,“锁定第一作案现场”。

第四步:下钻分析 - 深入“现场”找到根本原因

当第三步的关联分析将嫌疑指向某个具体的组件或资源后(例如,数据库),最后一步就是使用更专门的诊断工具,深入“现场”进行根因分析。

这里的行动路径非常明确:

- 若关联到 CPU 瓶颈:使用应用性能剖析器(Profiler)来分析是哪个方法或线程消耗了最多的 CPU 时间。

- 若关联到 内存 瓶颈:分析垃圾回收(GC)日志或导出堆转储快照(Heap Dump),排查是否存在内存泄漏或大对象问题。

- 若关联到 数据库 瓶颈:立即检查数据库的慢查询日志,并对高频、耗时的 SQL 语句进行执行计划分析。

- 若关联到 I/O 瓶颈:检查操作系统的磁盘读写队列长度和平均等待时间,定位是哪个进程在进行大量的读写操作。

从手动关联到智能诊断:更高效的性能短板定位方式

上述这套“侦探式”的分析框架虽然极其有效,但在今天日益复杂的分布式和微服务架构中,手动进行所有指标的关联分析,不仅耗时耗力,而且极易因为监控维度不全而遗漏关键线索。

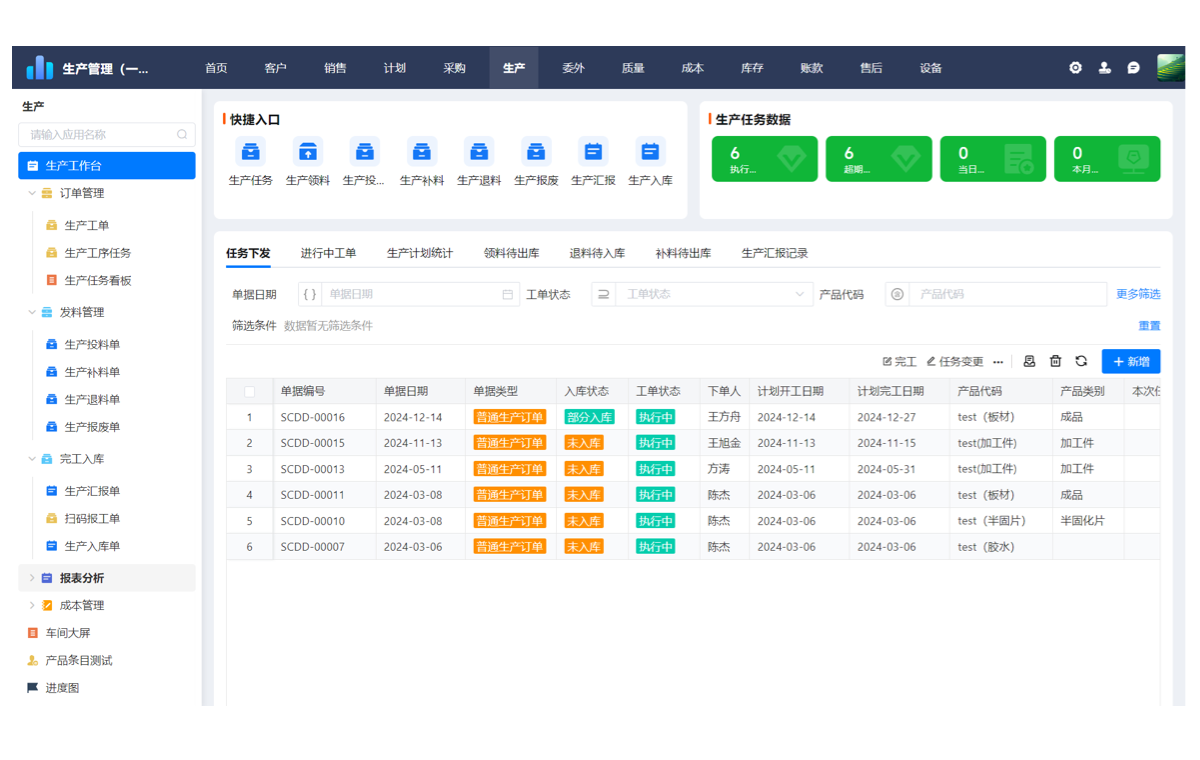

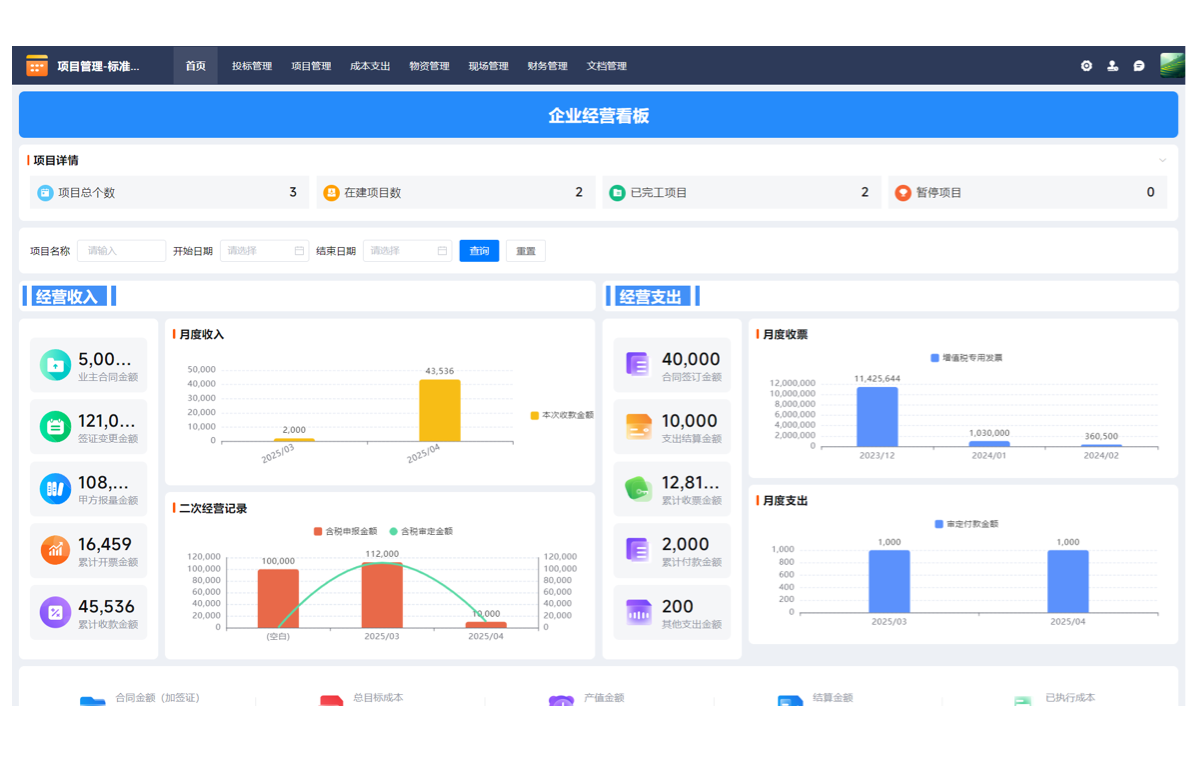

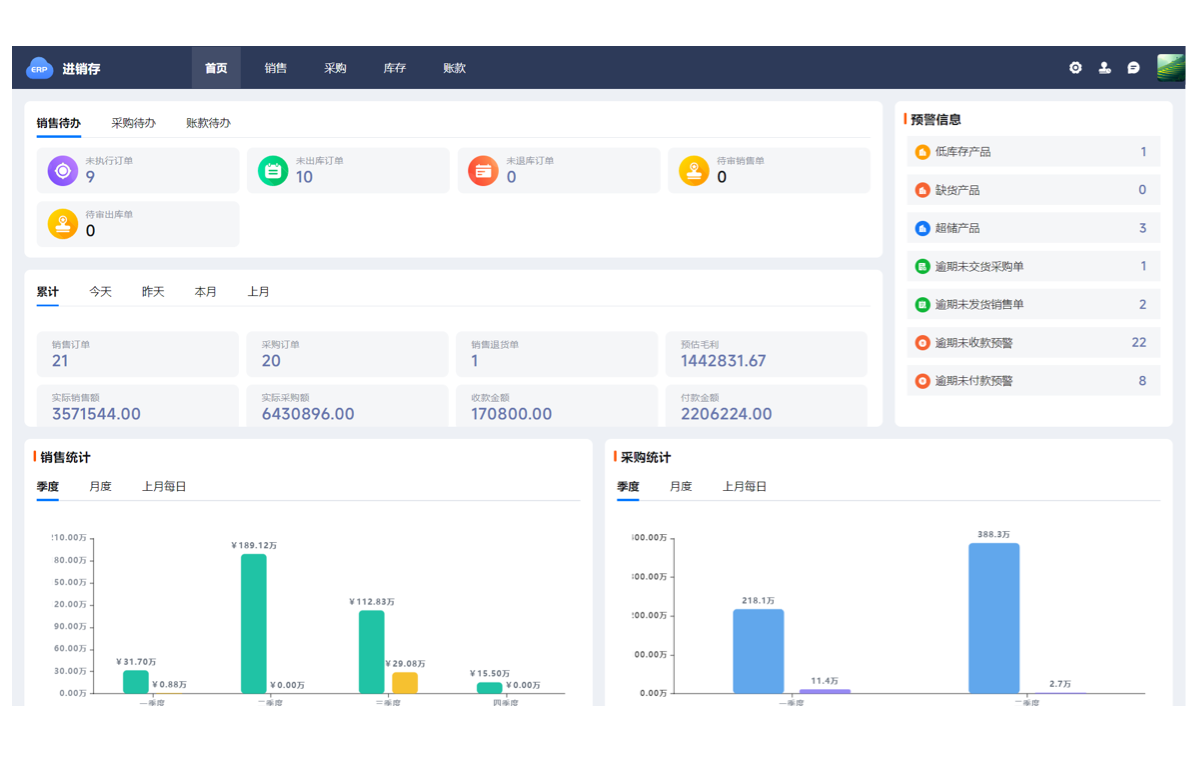

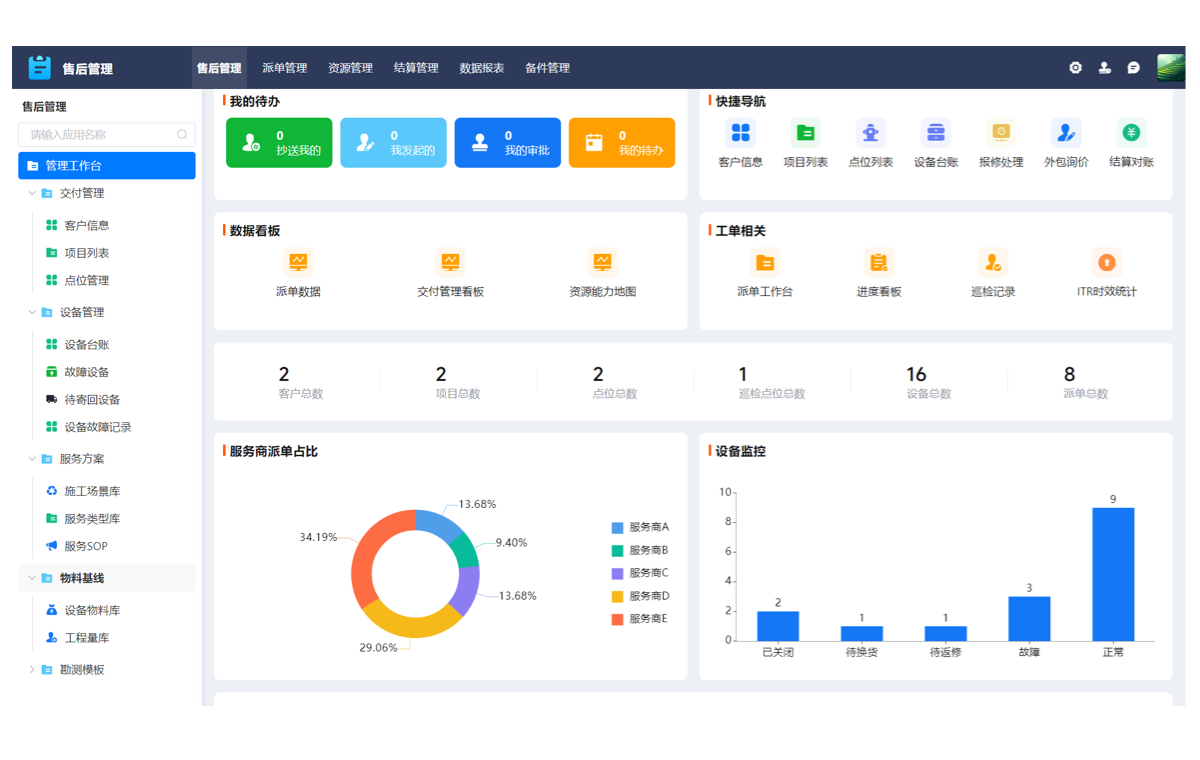

我们服务超过5000家企业的实践经验表明,将这套分析流程自动化的价值是巨大的。专业的应用性能监控(APM)工具,正是为此而生。例如在「支道」的产品体系中,已经将这套“侦探式”的关联分析与根因诊断流程深度整合并自动化,能够从海量数据中智能识别异常,并自动呈现问题背后的完整调用链与代码级瓶颈。

查看我们的实践案例,了解智能分析如何将性能瓶颈定位效率提升10倍。

总结:成为一名出色的性能“诊断专家”

性能分析并非依靠直觉的猜谜游戏,而是一套可以被严格执行的科学流程。要成为一名出色的性能“诊断专家”,关键在于建立正确的思维框架。

我们再次强调这个框架的核心:

- 三大原则:坚持关联分析,告别平均值陷阱,采用自顶向下的排查路径。

- 四步流程:首先定义性能基线,然后识别异常时间窗口,接着进行多维关联分析锁定嫌疑,最后下钻到具体组件进行根因诊断。

现在,你可以打开手边最近的一份性能测试报告,尝试用这个新框架重新审视其中的数据。你会发现,许多之前模糊不清的线索,都将变得清晰起来。