别再等问题失控,主动发现数据的“求救信号”

周一复盘会上才发现上周的核心推广渠道转化率骤降,或是半夜被紧急电话叫醒,只为修复一个导致用户无法支付的线上故障——这些被动“救火”的场景,正在持续消耗企业有限的资源。问题发生后才响应,代价远不止是直接的业务损失,更包括团队精力的内耗和用户信任的侵蚀。

搭建一套有效的质量异常预警系统,其目的就是将团队从被动响应中解放出来。这远比想象中简单,它并不必然要求复杂的算法或深厚的代码能力,关键在于遵循一个清晰、务实的配置框架,主动发现数据发出的早期“求救信号”。

告别复杂:一个“轻松有效”的预警系统应具备三大原则

在服务超过5000家企业的过程中,我们发现,成功的预警系统都遵循着相似的底层逻辑。它们并非大而全的技术堆砌,而是聚焦于效率与效果的平衡。

原则一:聚焦核心,而非全面覆盖

许多团队在初期就试图监控所有数据点,这往往导致系统过于臃肿且难以维护。正确的起点是应用80/20法则,优先监控那些能直接反映业务健康度的“生命线”指标。初期目标应该是抓住那些足以撼动业务根基的“大问题”,而不是纠结于所有细枝末节的波动。

原则二:规则驱动,而非算法先行

对于绝大多数业务场景,复杂的异常检测算法不仅开发周期长,其效果也未必优于简单的规则。我们必须认识到,固定阈值、同比/环比波动这类看似基础的规则,恰恰是最高效、最可靠的起点。在预警系统建设的初期,追求算法模型往往是一种过度优化,它会显著增加实施的复杂度和成本。

原则三:配置自动化,而非手动巡检

预警系统的核心价值,在于将人力从重复、低效的数据检查工作中解放出来。如果还需要团队成员每天定时定点地去查看几十张报表,那么这个系统就失去了意义。关键在于实现监控流程的自动化,并能通过多渠道将已确认的告警信息准确、自动地推送给相关负责人。

四步配置指南:从零开始搭建你的第一个质量异常预警系统

遵循以下四个步骤,任何团队都能在短时间内搭建起一套行之有效的基础预警系统。

第一步:选择监控指标 - 锁定你的业务“生命线”

配置的第一步,是回答一个根本问题:哪些数据的剧烈波动,会直接导致公司层面的业务损失?

这个问题的答案就是你的首批监控指标。它们通常不是过程性指标,而是结果性指标。例如:

- 电商业务: 订单量、支付成功率

- SaaS业务: 用户注册数、核心功能使用率

- 技术平台: 核心API调用成功率、服务响应时间

行动指南: 与业务或产品负责人沟通,共同圈定不超过3个首期监控指标。少即是多,这能确保团队将精力聚焦在最重要的问题上。

第二步:设定告警规则 - 为异常波动划定“红线”

确定指标后,需要为其定义“正常”与“异常”的边界。

方法1:设置静态阈值

这种方法简单直接,适用于那些有明确业务含义的绝对值指标。

- 适用场景: 错误数、队列积压量、失败次数等。

- 示例: 当“每分钟支付失败次数” > 10次时,系统应立即触发告警。

方法2:设定动态波动阈值

对于那些本身就存在周期性波动的指标,使用固定阈值极易产生误报。动态波动阈值是更合理的选择。

- 适用场景: DAU(日活跃用户数)、GMV(商品交易总额)、新增用户数等。

- 示例: 当“小时新增用户数”比昨天同一时间点下降超过30%时,触发告警。

在设定规则时,必须在灵敏度与准确率之间找到平衡。过于敏感的阈值会导致告警泛滥,让团队对警报麻木,即“狼来了”效应。初期的规则可以设置得相对宽松,在实际运行中根据反馈再逐步调优。

第三步:配置告警渠道 - 确保警报能被“听见”

告警如果不能被及时触达,就毫无意义。根据告警的优先级,选择不同的通知渠道是确保响应效率的关键。

- 即时通知类 (高优先级): 用于需要立即处理的严重故障。常见的渠道包括钉钉、企业微信、Slack的机器人通知。

- 邮件汇总类 (中优先级): 用于需要关注但无需立刻行动的异常。例如,每日或每周发送一份异常波动汇总报告。

- 接口调用类 (自动化处理): 更进一步,可以通过Webhook将告警事件推送给其他系统,触发自动化的处理流程,如服务降级或重启。

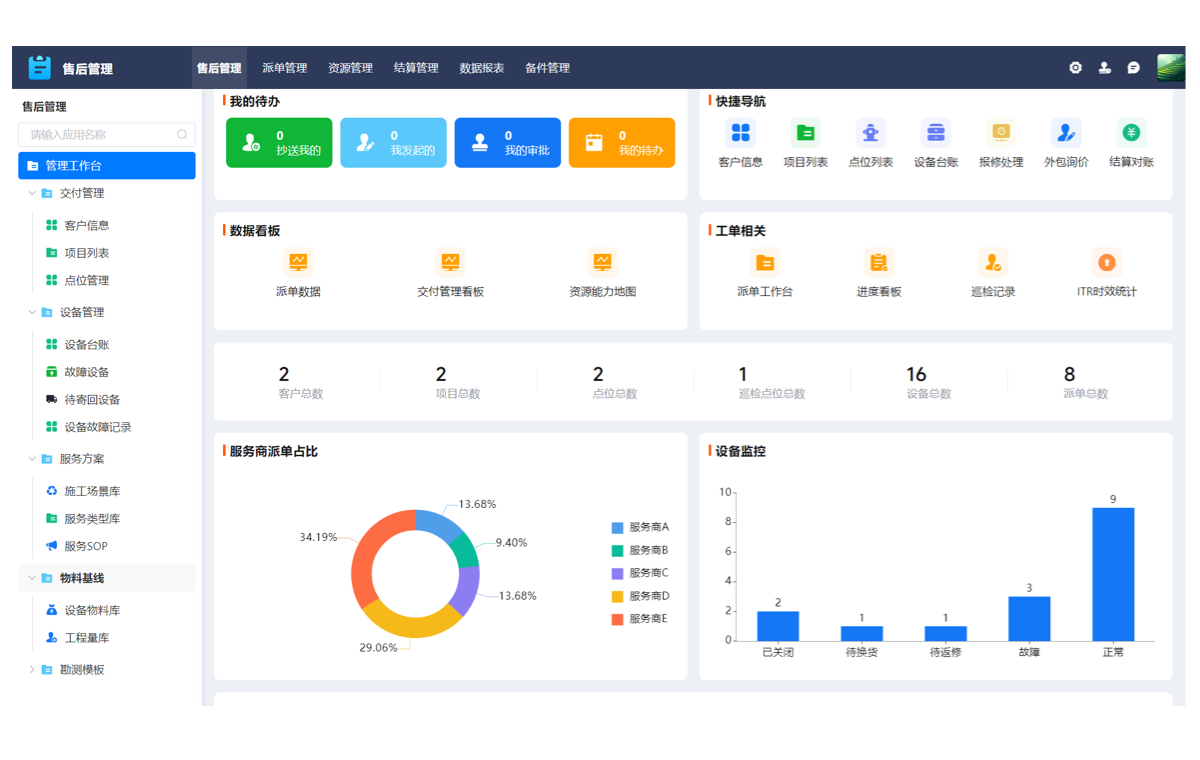

在配置时,清晰的分级和路由至关重要。例如,使用 [支道] 这样的平台,你可以在一个界面中轻松勾选,将定义为“P0级”的严重告警,同时推送到技术负责人的手机和核心研发团队的Slack群组,确保信息在第一时间被关键人员接收。

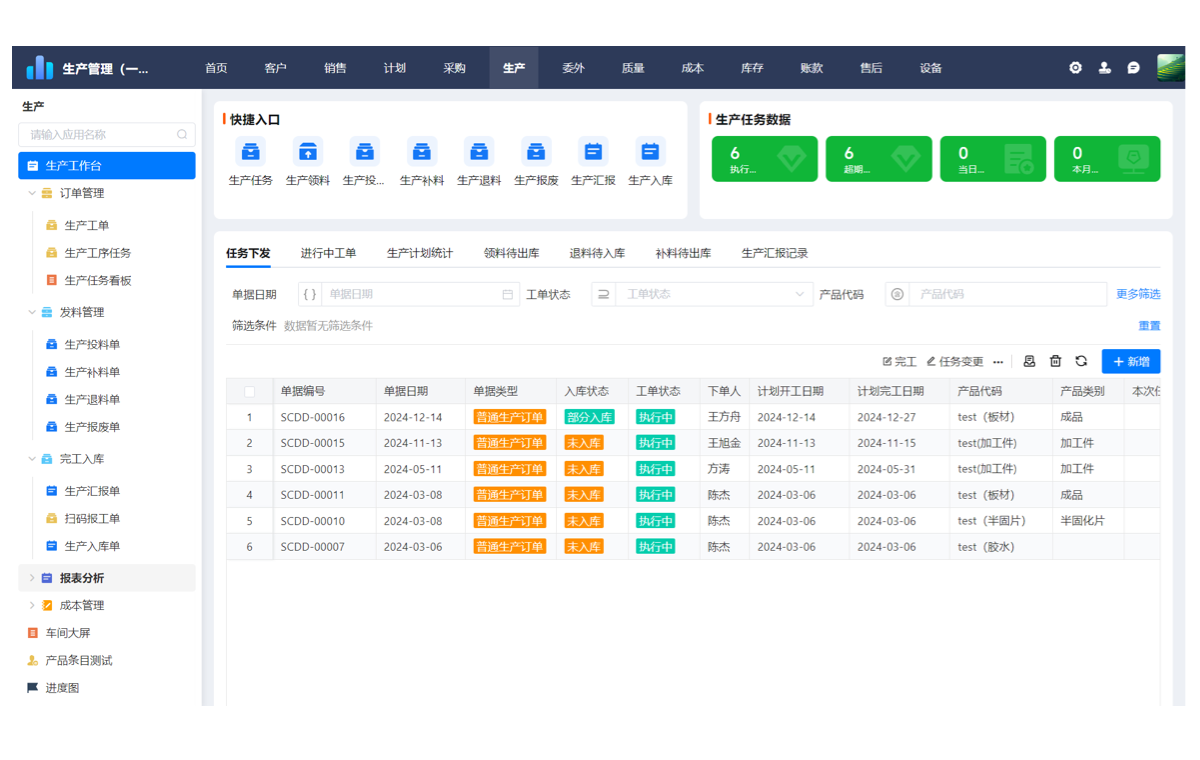

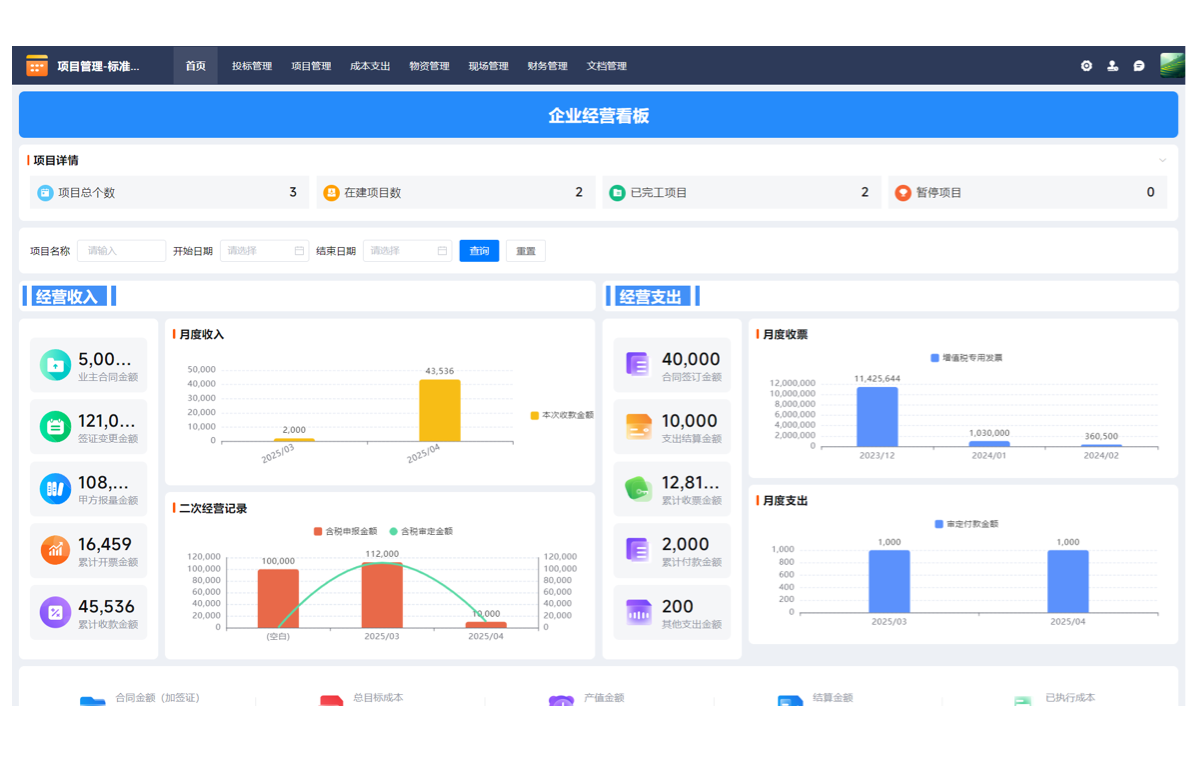

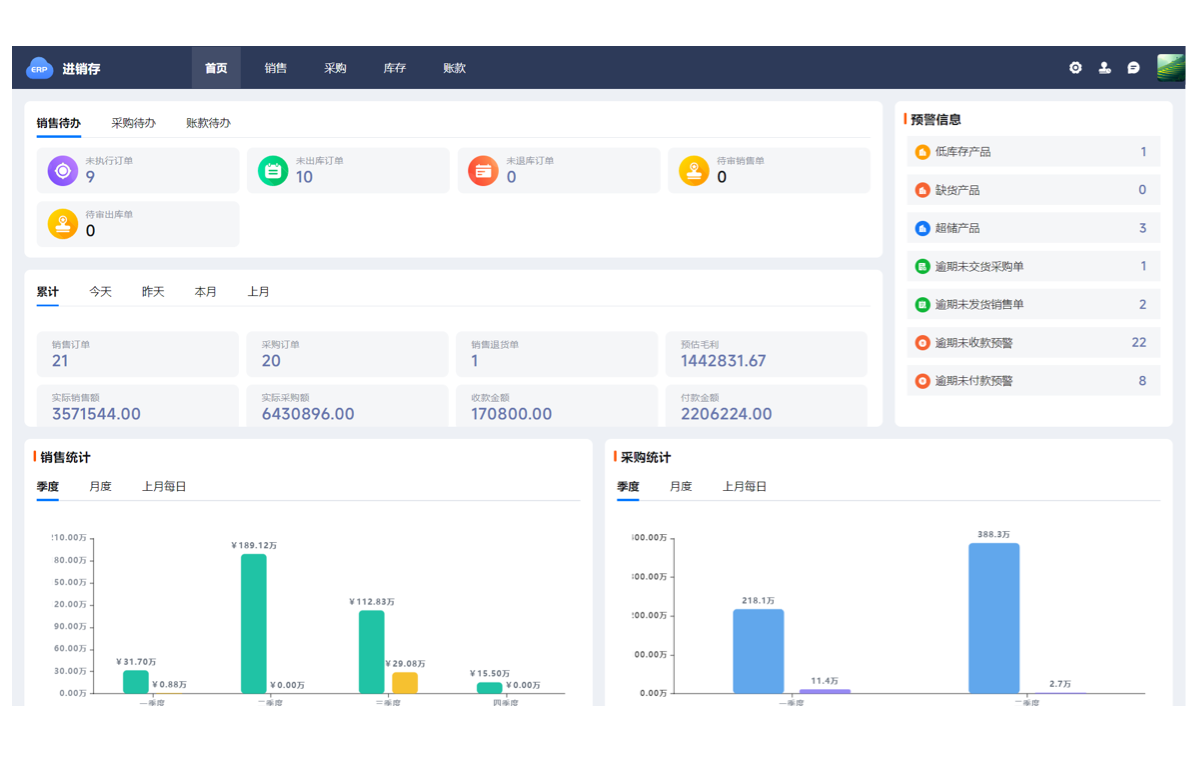

第四步:创建可视化看板 - 让异常状态一目了然

当告警触发时,团队需要一个能快速判断问题严重程度和影响范围的全局视图,而不是在一堆告警信息中寻找线索。

一个基础但有效的可视化看板,应至少包含以下三个要素:

- 核心指标实时趋势图: 直观展示被监控指标的当前走势和历史数据。

- 当前告警状态列表: 清晰列出正在发生的告警事件、等级和持续时间。

- 历史告警记录与处理日志: 方便复盘问题,并记录每次异常的处理过程和结论。

快速回顾:你的“质量异常预警系统”配置清单

在完成上述步骤后,可以通过这个清单进行一次快速自查:

- 是否已选定不超过3个核心监控指标?

- 是否已为每个指标配置了清晰的告警规则(阈值或波动)?

- 是否已设置了至少一种自动化告警通知渠道?

- 是否已建立一个能快速概览全局的可视化看板?

想了解领先的互联网公司是如何实践这套配置框架的吗?[查看 [支道] 客户的落地案例]

上线之后:如何评估预警效果并持续优化?

预警系统的上线只是开始,持续的评估与优化才是其生命力的保障。

评估效果的两个关键问题:

- 告警是否及时? 从问题实际发生到团队收到告警,这个时间间隔(MTTA)是多长?

- 告警是否准确? 系统产生的告警中,误报(False Positive)和漏报(False Negative)的比例是多少?

持续迭代的三个方向:

- 定期回顾告警日志: 分析历史告警数据,是优化阈值、减少误报最直接的依据。

- 根据团队反馈调整: 监控指标也需要迭代。随着业务发展,一些旧指标可能不再重要,而新的业务“生命线”则需要被纳入监控范围。

- 建立告警处理SOP: 逐步为不同类型、不同等级的告警建立标准操作流程(SOP),明确响应人、处理步骤和升级策略,将告警处理流程标准化。

总结:让数据为你站岗,告别“救火式”工作

我们必须明确,建立预警系统的目的,不是追求技术上的完美,而是为了在业务受到实质性损害前,获得宝贵的反应时间。你不需要成为数据专家,也能为你的业务建立起第一道坚实的防线。

遵循本文提出的四步框架,你今天就可以着手搭建一个基础但高效的质量异常预警系统,让数据真正成为24小时为你站岗的哨兵,最终帮助整个团队告别低效的“救火式”工作模式。

本文探讨的“轻松配置”理念,正是 [支道] 产品的核心。如果你希望将这套方法论一键落地,[点击了解 [支道] 如何帮你实现自动化数据质量监控]。