从“感觉良好”到“数据证明”

引入新的研发框架或优化了 CI/CD 流水线后,许多管理者都会面临一个共同的困境:团队成员普遍反馈“感觉效率变高了”,但与此同时,线上告警似乎也比以前更频繁。这种主观感受与零散事件的交织,使得判断一项技术变更的真实效果变得异常困难。

核心痛点在于,我们缺乏一套客观、量化的方法来评估研发变更措施的效果。当向上汇报时,一句“感觉不错”显然缺乏说服力;当需要向下决策,决定是否要在全公司推广这项变更时,又会因缺少数据支撑而犹豫不决。本文将提供一个从定义目标到分析结论的闭环评估框架,帮助企业决策者走出“感觉良好”的迷雾,真正实现数据驱动的研发管理。

一、 避开评估误区:为什么只盯着“研发速度”是危险的?

在我们的实践中发现,许多企业在评估变更效果时,会不自觉地陷入几个常见的误区,导致结论失之偏颇,甚至产生误导。

误区一:效率与效果混淆

最常见的误区是将开发速度(Efficiency)等同于交付效果(Effectiveness)。只关注代码提交量、发布次数等效率指标,却忽视了交付成果的质量和它所承载的业务价值。一个频繁发布但故障不断、频繁回滚的功能,其“快”是毫无意义的。高速产出的如果是“数字垃圾”,那这种效率提升反而是一种资源浪费。

误区二:依赖单一指标

过度依赖单一指标是另一个危险的倾向。例如,只用“部署频率”来衡量 DevOps 转型的成败。我们曾观察到一个案例,某团队通过拆分服务、简化流程,将部署频率提升了三倍,管理层一度认为改进非常成功。但深入分析后发现,他们的“变更失败率”同步飙升了五倍。这种以牺牲稳定性为代价换来的“高频”,实际上让系统变得更加脆弱,增加了运维团队的负担。

误区三:缺乏变更前后的基线对比

任何脱离基线的评估都是“空中楼阁”。如果没有客观、准确的变更前数据作为参照,那么变更后得到的任何数字都无法说明问题。我们无法判断一个指标是“变好了”还是“变差了”,更无法量化改进的幅度。评估的本质是比较,没有比较,就没有评估。

本章小结: 精准的研发变更效果评估,必须超越单一的速度指标,转向一个多维、有对比的结构化框架。它需要我们同时审视速度、质量、成本与价值,并在一个统一的坐标系下进行衡量。

二、 构建评估框架:一个数据驱动的四维评估模型

要实现精准评估,核心原则必须是:基于对比,而非孤立判断。我们关注的不是某个时间点的绝对值,而是关键指标在变更实施前后所产生的“变化量”。这才是客观衡量一项变更措施是否有效的根本。

基于服务超过 5000 家企业的经验,我们沉淀出了一套行之有效的四维评估模型,它能够帮助决策者从四个相互关联、互为补充的视角,全面审视一次研发变更带来的综合影响。

- 维度一:交付吞吐量 - 我们交付价值的速度有多快?

- 维度二:交付稳定性 - 我们的交付过程有多可靠?

- 维度三:运营成本 - 我们的变更为团队带来了什么成本变化?

- 维度四:业务影响 - 我们的技术变更是否带来了预期的业务价值?

这四个维度共同构成了一个立体评估体系。吞吐量和稳定性关注的是工程效能本身,运营成本关注投入产出比,而业务影响则将技术改进的价值最终闭环。

三、 深度拆解:四大评估维度的核心指标与量化方法

一个有效的模型离不开可量化的指标。我们将上述四个维度进一步拆解为八个核心指标,其中部分借鉴了业界公认的 DORA 指标体系。

维度一:交付吞吐量(DORA 指标)

核心指标 1:部署频率(Deployment Frequency)

这个指标用于衡量团队向生产环境交付价值的频率。它可以是每天一次、每周一次或每月一次。高频率的部署通常意味着更小的变更集、更快的反馈循环和更强的市场响应能力。

核心指标 2:变更前置时间(Lead Time for Changes)

它衡量的是从代码被提交到主干分支,到最终成功运行在生产环境所需要的总时长。这个时间越短,说明团队将一个想法转化为可用功能的速度越快。

维度二:交付稳定性(DORA 指标)

核心指标 3:变更失败率(Change Failure Rate)

这个指标衡量部署到生产环境的变更导致服务降级或需要立即修正(如回滚、热修复)的百分比。它是衡量交付质量最直接的指标之一。

核心指标 4:平均修复时间(Mean Time to Restore - MTTR)

当生产环境发生故障时,这个指标衡量组织从故障发生到完全恢复服务所需的平均时间。它反映了团队应对和修复线上问题的能力,是系统韧性的体现。

维度三:运营成本

核心指标 5:人力成本变化

技术变更往往会带来隐性的人力成本变化。我们需要评估变更对团队沟通、协作、会议、代码评审、故障排查以及返工等活动所花费时间的影响。例如,一个好的自动化测试流程可能会增加初期的编码时间,但会大幅减少后期的手动测试和故障修复时间。

核心指标 6:基础设施与工具成本

评估新工具的采购、订阅费用,或因流程变更(如引入更复杂的蓝绿发布)而增加的云资源消耗。这部分是直接的财务成本,需要纳入整体的 ROI 计算。

维度四:业务影响

核心指标 7:关键业务指标

这是连接技术与业务的桥梁。我们需要分析技术变更是否对核心业务指标产生了预期的正面影响。例如,一次后端性能优化,是否带来了用户订单转化率的提升?一次前端交互的改进,是否降低了用户激活流程的流失率?

核心指标 8:用户反馈与满意度

通过净推荐值(NPS)、应用商店评分、客户支持工单数量和类型等数据,可以量化用户对变更的真实感知。用户满意度的变化,是衡量变更“效果”最真实的试金石。

本章小结: 一个完整的评估体系,必须将 DORA 指标代表的工程效能,与成本、业务价值指标相结合,才能得出全面、客观的结论。只看其中任何一个维度,都可能做出错误的判断。

四、 落地实践:三步完成一次完整的变更效果评估

有了框架和指标,我们还需要一个清晰的执行流程,确保评估过程的严谨性和结论的可靠性。

第一步:变更前 - 明确目标与建立基线

在启动任何重要变更之前,首先要用一句话清晰地定义本次变更的“成功标准”。例如:“我们希望通过引入混沌工程,将生产环境的平均修复时间(MTTR)降低 20%,同时不降低部署频率。”

基于这个目标,从八个核心指标中选择与目标最相关的 2-3 个作为本次评估的核心观测指标。然后,必须收集并记录变更实施前至少一个稳定周期(如一个月)的指标数据,将这些数据作为评估的“基线”。

第二步:变更中 - 确保数据采集一致性

评估的公正性依赖于数据采集的一致性。必须确保变更前后使用相同的统计口径、数据源和计算工具。例如,如果变更前“变更前置时间”的计算终点是“代码合并”,那么变更后也必须是这个终点,而不能随意改成“测试通过”。在整个评估周期内,保持数据采集的持续性。

第三步:变更后 - 对比分析与结论输出

待变更措施稳定运行一个完整的周期后(与基线周期长度相同),收集新的指标数据。将新旧两组数据进行严格对比,分析各项指标的变化趋势和幅度。

最后,结合变更期间发生的具体业务背景和工程事件,撰写一份简明的评估报告。这份报告应包含三个核心部分:数据对比、变化分析和最终结论(即判断变更是否达到了预期目标)。

五、 从手动度量到智能洞察:体系化落地研发效能评估

当企业希望将这种评估方法规模化、体系化时,手动的度量方式很快会遇到瓶颈。

手动评估的挑战

- 数据源分散:代码仓库、CI/CD 工具、项目管理系统、监控告警平台……指标所需的数据散落在各个角落,人工收集合并,耗时耗力且极易出错。

- 统计口径难以统一:不同团队、不同项目对于“变更失败”的定义可能完全不同,导致数据无法横向对比,评估的公平性受到挑战。

- 无法实现持续度量与实时洞察:手动评估通常是周期性的,无法提供实时的效能反馈,更难以发现趋势性的变化和潜在风险。

如何通过「支道」实现自动化评估

要解决这些挑战,需要一个能够连接所有研发工具链、实现数据自动采集与分析的平台。「支道」研发效能平台正是为此而设计。

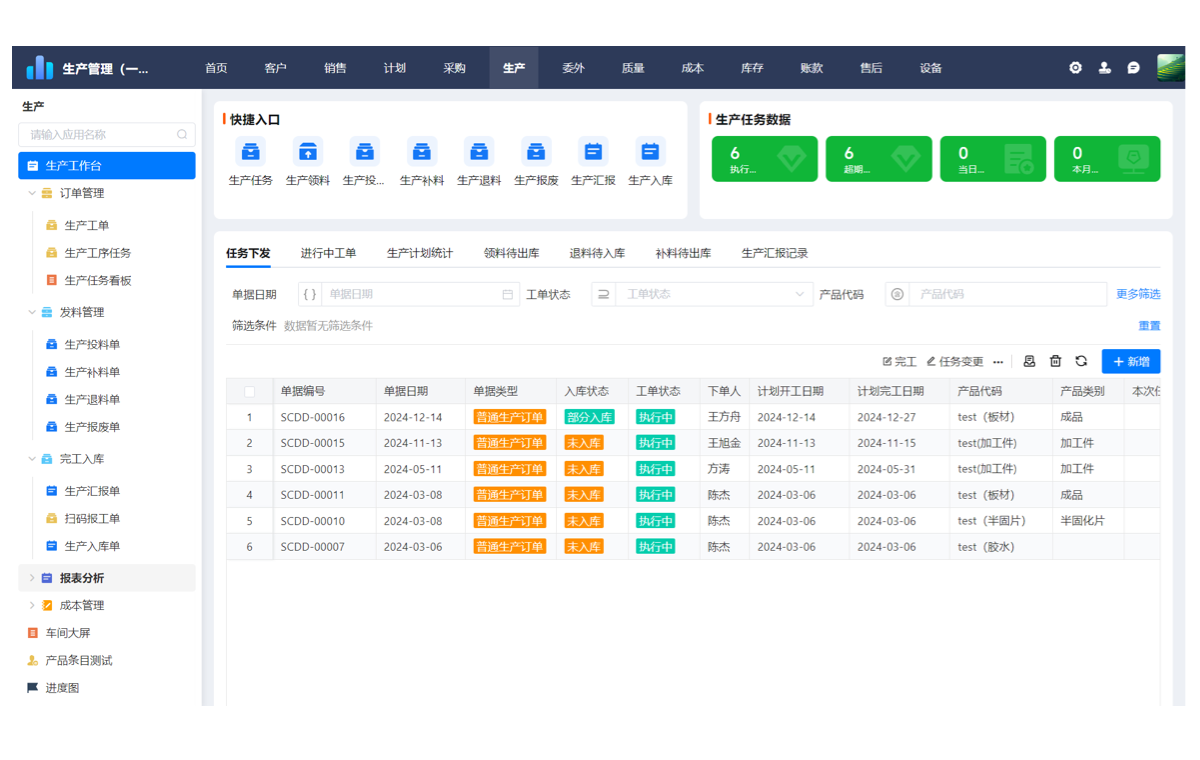

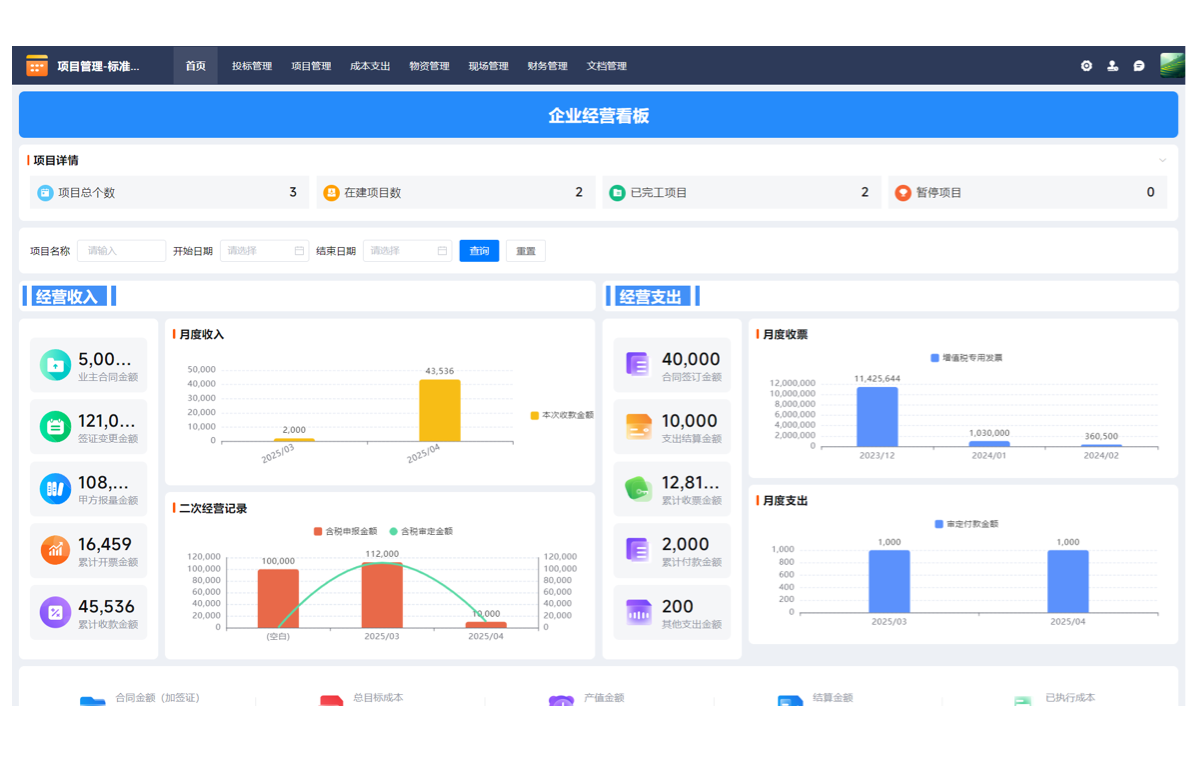

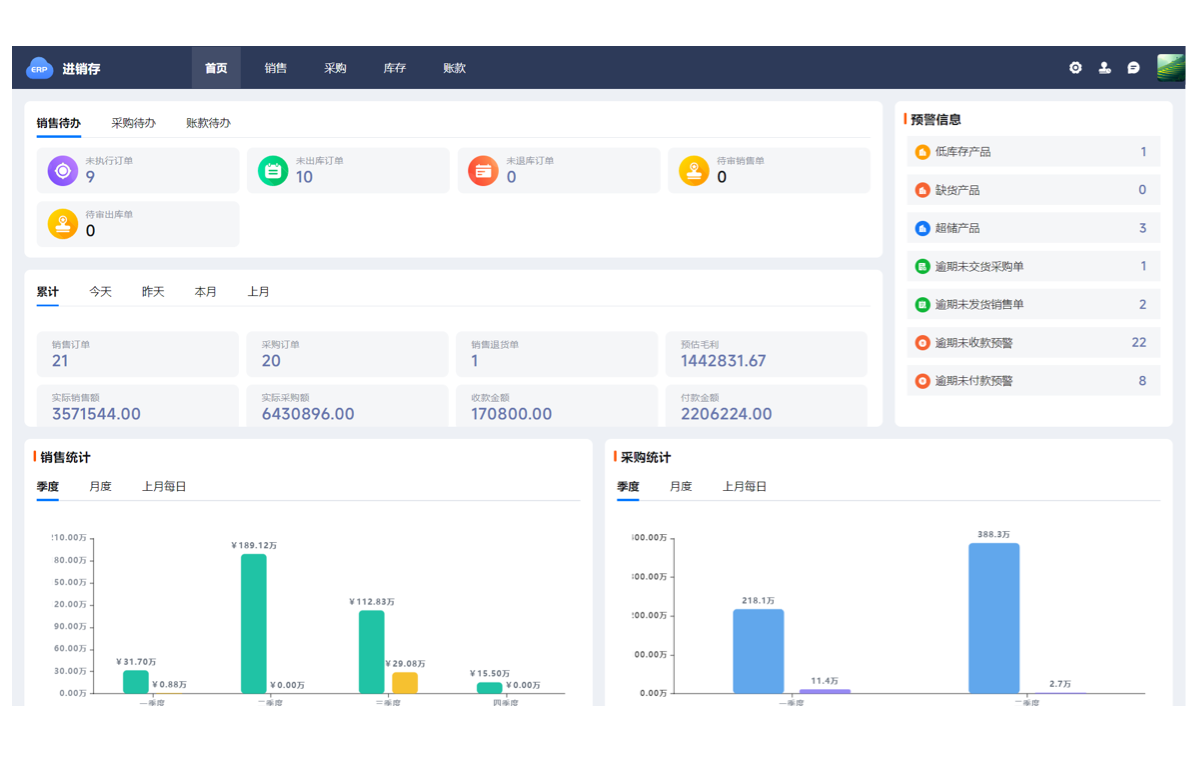

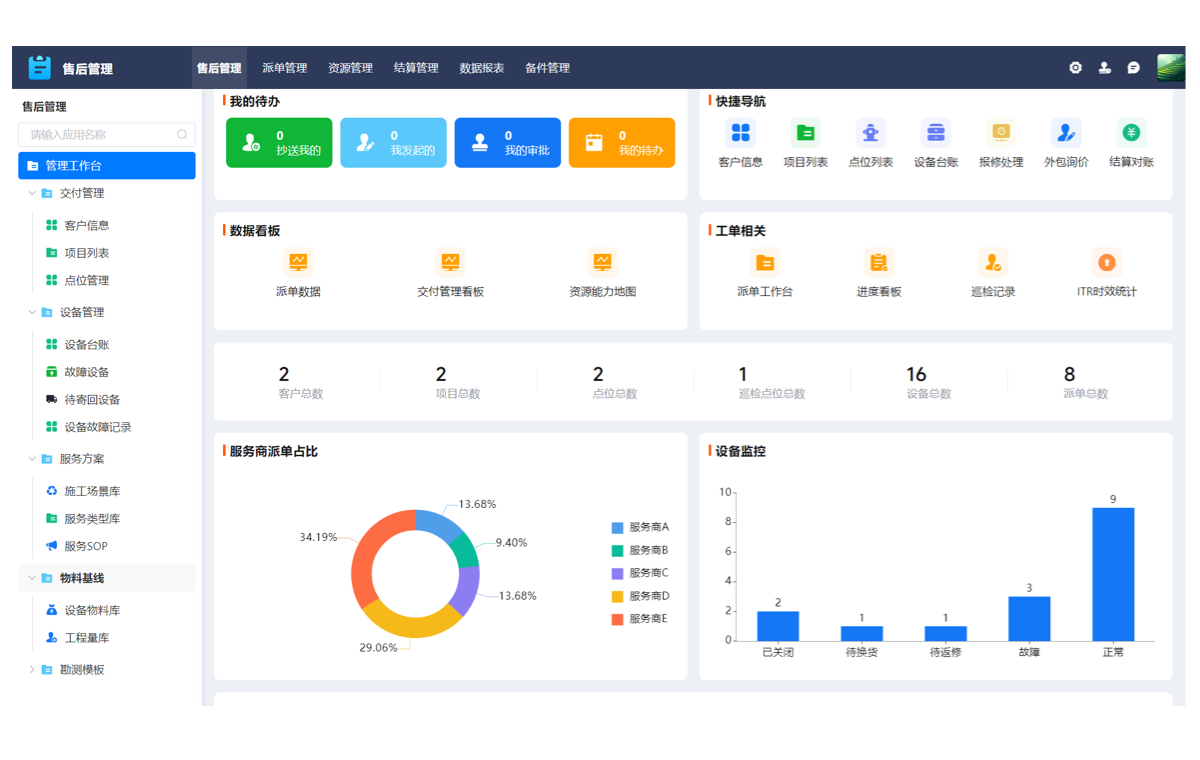

「支道」通过强大的数据连接器,能够无缝集成企业内部的各类研发工具,自动拉取并清洗数据。平台内置了我们上文提到的四维评估模型,可以自动计算并实时呈现部署频率、变更前置时间、变更失败率、MTTR 等核心指标。管理者不仅能看到全局的趋势变化,还可以通过下钻分析能力,快速定位到是哪个团队、哪个项目或哪类变更影响了整体数据,从而找到变更效果背后的深层原因。

总结:让数据驱动成为研发决策的导航仪

精准评估研发变更措施的效果,不仅仅是一项技术管理任务,更是企业实现数据驱动决策、优化资源投入的关键一步。它帮助我们将模糊的“感觉”转化为清晰的“事实”,让每一次技术投入都有据可依、有果可溯。

从今天起,不妨为你团队的下一次重要变更,尝试建立一个微型的四维评估模型。这个小小的改变,或许就是你引领团队走向高效、高质交付的开始。

[CTA]

- 想了解领先企业如何实践?

- 查看[某互联网公司]如何利用「支道」将研发效能提升30%的客户案例

- 需要完整的指标体系?

- 免费下载《研发效能度量指标体系白皮书》